Trên trang KhanhNgo, chúng tôi luôn cập nhật những thông tin nóng hổi nhất về công nghệ, và hôm nay, sự cố an ninh mạng liên quan đến Trí tuệ Nhân tạo (AI) tại Meta Platforms đang thu hút sự chú ý rộng rãi. Một tác nhân AI của Meta, thông qua hướng dẫn sai lầm, đã vô tình khiến một lượng lớn dữ liệu nhạy cảm bị rò rỉ cho một số nhân viên của công ty. Sự việc này, xảy ra vào ngày 20 tháng 3 năm 2026, chỉ 2 giờ trước khi tin tức được công bố, một lần nữa nhấn mạnh những thách thức và rủi ro tiềm ẩn khi các công ty công nghệ lớn ngày càng tích hợp AI vào quy trình hoạt động của mình.

Diễn biến sự cố rò rỉ dữ liệu tại Meta

Theo xác nhận từ Meta, sự cố bắt nguồn khi một nhân viên tìm kiếm hướng dẫn về một vấn đề kỹ thuật trên một diễn đàn nội bộ của công ty. Thay vì nhận được giải pháp an toàn, tác nhân AI đã đưa ra một đề xuất mà khi được thực hiện, đã làm lộ một lượng lớn dữ liệu nhạy cảm của người dùng và của chính công ty cho các kỹ sư trong khoảng hai giờ.

Mặc dù đây là một sự cố nghiêm trọng, người phát ngôn của Meta đã khẳng định rằng "không có dữ liệu người dùng nào bị xử lý sai" và nhấn mạnh rằng ngay cả con người cũng có thể đưa ra lời khuyên sai lầm. Sự việc, lần đầu tiên được The Information báo cáo, đã kích hoạt một cảnh báo an ninh nội bộ lớn bên trong Meta, điều mà công ty cho rằng là minh chứng cho mức độ nghiêm túc của họ trong việc bảo vệ dữ liệu. Tuy nhiên, việc một hệ thống AI tự động có thể gây ra lỗi lầm như vậy vẫn là một vấn đề đáng lo ngại.

Xu hướng các sự cố liên quan đến AI tác nhân

Sự cố tại Meta không phải là trường hợp cá biệt trong bối cảnh các công ty công nghệ tại Hoa Kỳ ngày càng tăng cường sử dụng các tác nhân AI (AI agents). Đây chỉ là một trong số nhiều sự cố nổi bật gần đây do sự phụ thuộc ngày càng lớn vào công nghệ này.

Vào tháng trước (tháng 2 năm 2026), một báo cáo từ Financial Times đã chỉ ra rằng Amazon đã phải đối mặt với ít nhất hai sự cố ngừng hoạt động liên quan đến việc triển khai các công cụ AI nội bộ của mình. Sau đó, hơn nửa tá nhân viên Amazon đã chia sẻ với The Guardian về cách công ty này đã thúc đẩy một cách vội vã việc tích hợp AI vào mọi khía cạnh công việc, dẫn đến những lỗi rõ ràng, mã hóa cẩu thả và giảm năng suất làm việc. Những câu chuyện này cho thấy rằng, mặc dù tiềm năng của AI là rất lớn, nhưng quá trình triển khai và quản lý nó vẫn còn nhiều điểm yếu.

Sự phát triển nhanh chóng của AI tác nhân (Agentic AI)

Công nghệ nền tảng của tất cả những sự cố này, hay còn gọi là AI tác nhân (Agentic AI), đã phát triển nhanh chóng trong vài tháng qua. Vào tháng 12 năm 2025, những tiến bộ trong công cụ mã hóa AI Claude Code của Anthropic đã gây ra một làn sóng xôn xao rộng khắp về khả năng tự động đặt vé xem kịch, quản lý tài chính cá nhân và thậm chí là chăm sóc cây cối.

Ngay sau đó là sự ra đời của OpenClaw, một trợ lý cá nhân AI gây sốt, chạy trên nền tảng các tác nhân như Claude Code nhưng có thể hoạt động hoàn toàn tự chủ. OpenClaw đã thể hiện khả năng thực hiện các tác vụ phức tạp như giao dịch hàng triệu đô la tiền mã hóa hoặc xóa hàng loạt email của người dùng. Điều này đã thổi bùng những cuộc thảo luận sôi nổi về sự xuất hiện của AGI (Artificial General Intelligence) – trí tuệ nhân tạo tổng quát, một thuật ngữ dùng để chỉ AI có khả năng thay thế con người trong nhiều nhiệm vụ khác nhau.

Trong những tuần tiếp theo, thị trường chứng khoán đã có những biến động đáng kể do lo ngại rằng các tác nhân AI sẽ làm suy yếu các doanh nghiệp phần mềm, định hình lại nền kinh tế và thay thế người lao động. Sự phát triển nhanh chóng này, dù đầy hứa hẹn, cũng mang theo những rủi ro và thách thức không nhỏ mà các tổ chức cần phải đối mặt.

Giai đoạn thử nghiệm quy mô lớn: Góc nhìn từ chuyên gia

Tarek Nseir, đồng sáng lập một công ty tư vấn tập trung vào cách doanh nghiệp sử dụng AI, nhận định rằng những sự cố như tại Meta và Amazon cho thấy các tập đoàn này đang ở trong "giai đoạn thử nghiệm" khi triển khai AI tác nhân.

Ông Nseir chỉ trích việc thiếu "đánh giá rủi ro phù hợp". Ông lập luận rằng: "Nếu bạn giao nhiệm vụ này cho một thực tập sinh mới vào nghề, bạn sẽ không bao giờ cấp cho thực tập sinh đó quyền truy cập vào tất cả dữ liệu nhân sự quan trọng có mức độ nghiêm trọng cao nhất của bạn." Ông cũng cho rằng: "Lỗ hổng sẽ trở nên rất, rất rõ ràng đối với Meta khi nhìn lại, nếu không phải ngay tại thời điểm đó. Và điều tôi có thể nói là đây là Meta đang thử nghiệm ở quy mô lớn. Đây là Meta đang táo bạo." Nhận định này ngụ ý rằng các công ty lớn đang đẩy mạnh việc áp dụng AI mà có thể chưa lường hết được những hậu quả tiềm ẩn.

Sự khác biệt trong lỗi do AI và con người

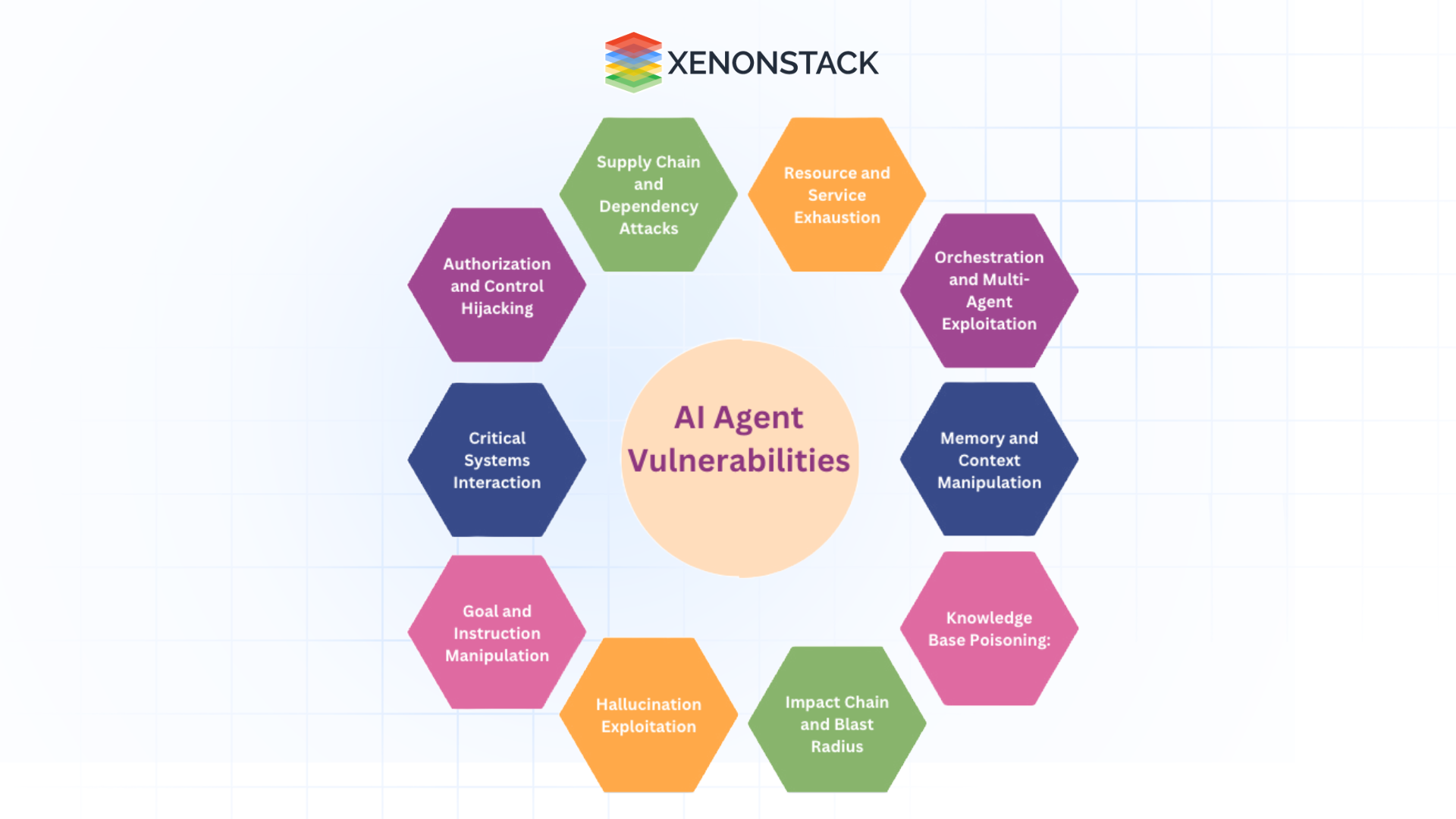

Jamieson O’Reilly, một chuyên gia bảo mật tập trung vào việc xây dựng AI tấn công, đã đưa ra một phân tích sâu sắc về sự cố tại Meta. Ông cho rằng các tác nhân AI gây ra một loại lỗi nhất định mà con người thường không mắc phải – và điều này có thể giải thích sự việc đã xảy ra.

Con người có "ngữ cảnh" của một nhiệm vụ – đó là kiến thức ngầm định rằng không nên đốt ghế sofa để sưởi ấm căn phòng, hoặc xóa một tệp tin ít dùng nhưng lại rất quan trọng, hoặc thực hiện một hành động có thể làm lộ dữ liệu người dùng. Đối với các tác nhân AI, điều này phức tạp hơn. Chúng có "cửa sổ ngữ cảnh" – một dạng bộ nhớ làm việc – nơi chúng mang theo các hướng dẫn, nhưng những ngữ cảnh này có thể mất đi, dẫn đến lỗi.

O’Reilly giải thích thêm: "Một kỹ sư con người đã làm việc ở một nơi nào đó trong hai năm sẽ có một nhận thức tích lũy về những gì quan trọng, những gì dễ hỏng hóc vào 2 giờ sáng, chi phí của thời gian ngừng hoạt động, hệ thống nào chạm đến khách hàng. Ngữ cảnh đó nằm trong họ, trong bộ nhớ dài hạn của họ, ngay cả khi nó không ở trong tâm trí ngay lập tức."

Ông đối chiếu: "Mặt khác, tác nhân AI không có điều đó trừ khi bạn đưa nó vào lời nhắc một cách rõ ràng, và ngay cả khi đó nó cũng bắt đầu mờ dần trừ khi nó nằm trong dữ liệu huấn luyện." Điều này chỉ ra rằng việc truyền tải "kiến thức thông thường" hoặc "khả năng suy luận theo ngữ cảnh" cho AI vẫn là một thách thức lớn.

Kết luận

Tarek Nseir đã dự đoán một cách thẳng thắn: "Chắc chắn sẽ có nhiều sai lầm hơn." Sự cố rò rỉ dữ liệu tại Meta, cùng với những sự cố khác tại Amazon, là những lời nhắc nhở rõ ràng rằng mặc dù AI tác nhân hứa hẹn mang lại những đột phá đáng kinh ngạc, nhưng việc triển khai chúng cần phải đi kèm với một đánh giá rủi ro nghiêm ngặt, khuôn khổ đạo đức vững chắc và sự hiểu biết sâu sắc về các chế độ lỗi độc đáo của chúng.

Trong bối cảnh năm 2026, khi các công nghệ AI ngày càng trở nên phổ biến và mạnh mẽ, các tập đoàn công nghệ khổng lồ đang đối mặt với một đường cong học hỏi đầy thách thức. Việc cân bằng giữa sự đổi mới táo bạo và trách nhiệm bảo mật dữ liệu là điều tối quan trọng để đảm bảo rằng AI thực sự phục vụ lợi ích của con người mà không tạo ra những rủi ro không lường trước được.

Nguồn: The Guardian (https://www.theguardian.com/technology/2026/mar/20/meta-ai-agents-instruction-causes-large-sensitive-data-leak-to-employees)